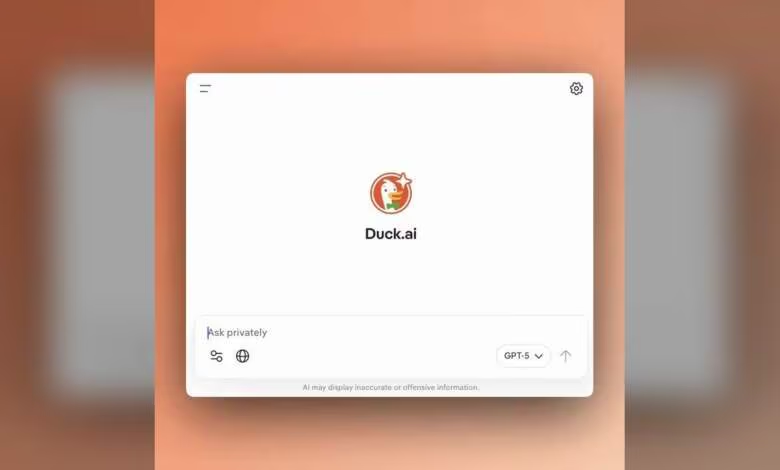

DuckDuckGo a dévoilé le 19 février une brique d’édition d’images par IA au sein de Duck.ai. Le service est gratuit avec quotas et s’utilise sans inscription : on charge une image et on décrit l’ajustement souhaité, le tout opéré par un modèle OpenAI côté serveur.

Fonctionnement et périmètre

L’outil se déclenche depuis la barre latérale de Duck.ai via « Nouvelle image », puis « Démarrer depuis une image ». JPEG, PNG et WebP sont acceptés, avec un simple glisser-déposer. Les requêtes textuelles peuvent couvrir des retouches de fond, des suppressions d’objets ou des transformations ciblées, par exemple « remplacer l’arrière-plan par un ciel étoilé » ou « retirer le mug à gauche ».

La génération d’images était déjà disponible depuis fin 2025 chez DuckDuckGo. Cette brique d’édition abaisse le seuil d’accès aux retouches guidées par texte sans imposer de compte, ce qui aligne Duck.ai sur les usages rapides de correction et de dérush d’assets visuels.

Mesures de confidentialité

DuckDuckGo affirme retirer systématiquement les métadonnées des images et l’adresse IP avant d’envoyer les requêtes au modèle d’OpenAI. Les images sources restent stockées localement sur l’appareil de l’utilisateur et ne sont pas conservées côté cloud, limitant la surface de corrélation et de réidentification par le fournisseur de modèle.

Ce choix d’architecture renforce la promesse de non-traçage chère au moteur, tout en s’appuyant sur l’inférence distante d’OpenAI pour la qualité des retouches. Reste à juger en pratique la précision des masques et la fidélité des modifications sur des scènes complexes, un point où les modèles varient sensiblement.

En ajoutant l’édition à sa génération, DuckDuckGo densifie une offre IA orientée usage immédiat et confidentialité. La combinaison « sans compte + quotas gratuits + désanonymisation en amont » place Duck.ai comme alternative pragmatique aux éditeurs IA des suites créatives, avec un risque d’adoption rapide pour les tâches légères de retouche où la latence réseau importe moins que la friction d’accès.

Source : ITHome