Google affirme avoir observé un premier cas documenté d’exploitation zero‑day « assistée par IA », détecté et stoppé avant une campagne à grande échelle. La cible était un outil open source de gestion Web non nommé, avec un contournement de l’authentification à deux facteurs en ligne de mire. Le Google Threat Intelligence Group (GTIG) dit avoir interrompu la chaîne d’attaque et prévenu les développeurs concernés.

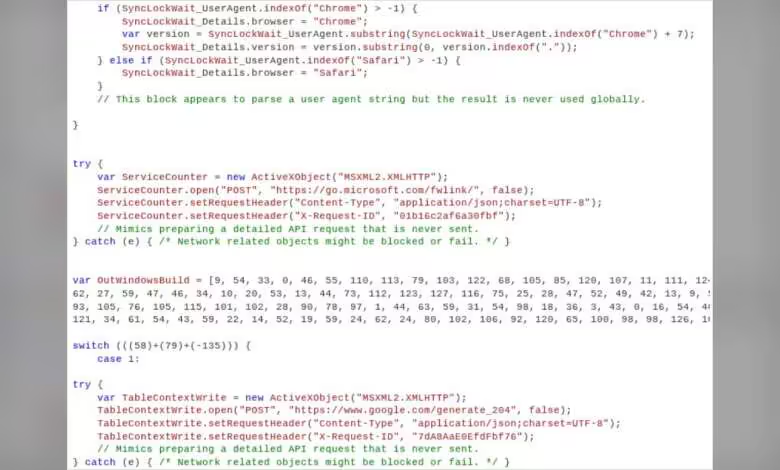

Les indices techniques relevés par GTIG pointent vers une implication directe d’un grand modèle de langage dans la genèse du code malveillant : abondance de docstrings au ton pédagogique, présence d’un score CVSS « halluciné », et un style Python très « didactique », typique de corpus d’entraînement de LLM. Google ne précise pas quel modèle a été utilisé.

Un bug de logique métier, pas une corruption mémoire

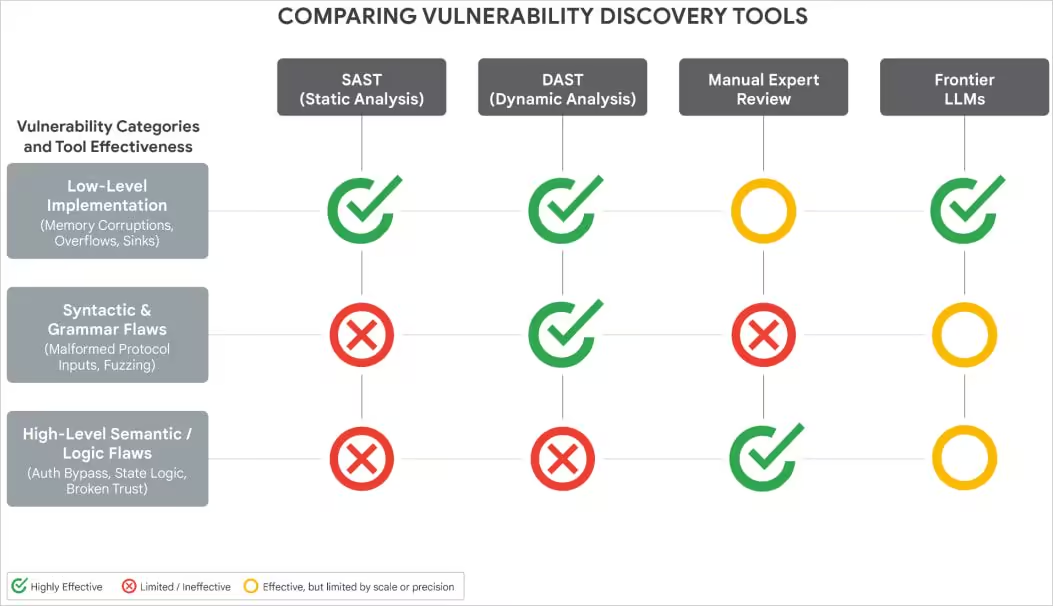

Le vecteur exploité correspond davantage à des vulnérabilités sémantiques et de logique métier qu’à des failles de bas niveau détectées par fuzzing ou analyse statique. Ce profil est cohérent avec les forces actuelles des modèles génératifs pour analyser des parcours applicatifs, agréger des indices de surface et recomposer des étapes d’abus.

Pour les équipes défensives, l’enjeu immédiat dépasse le cas isolé : l’IA réduit le coût et le temps nécessaires à l’analyse, à l’écriture de scripts et à la validation d’exploits. Résultat, les interfaces d’administration exposées sur Internet voient mécaniquement leur surface de risque grimper, même sans nouvelle classe de failles.

La portée industrielle est claire : la démocratisation des capacités offensives par les LLM accélère le rythme de « weaponization » des bugs de logique. Les projets open source et les éditeurs d’outils d’admin devront rehausser leurs contrôles d’authentification hors parcours nominal, multiplier les protections contextuelles côté serveur et renforcer la télémétrie pour couper plus tôt les chaînes d’attaque, y compris quand elles s’appuient sur des scripts générés à la volée.

Source : ITHome