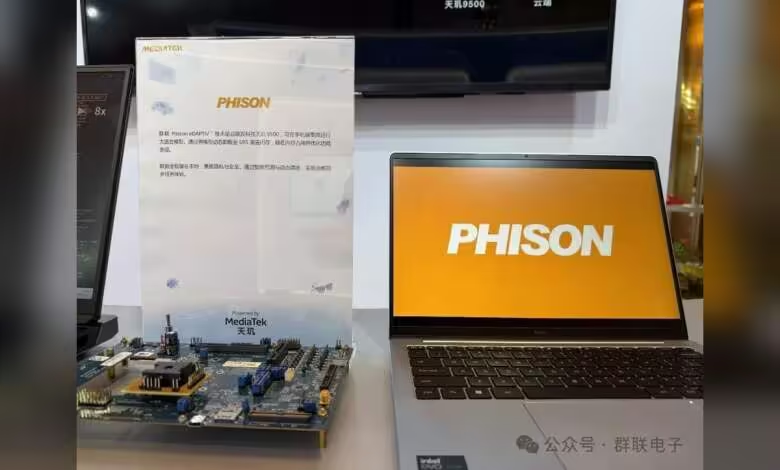

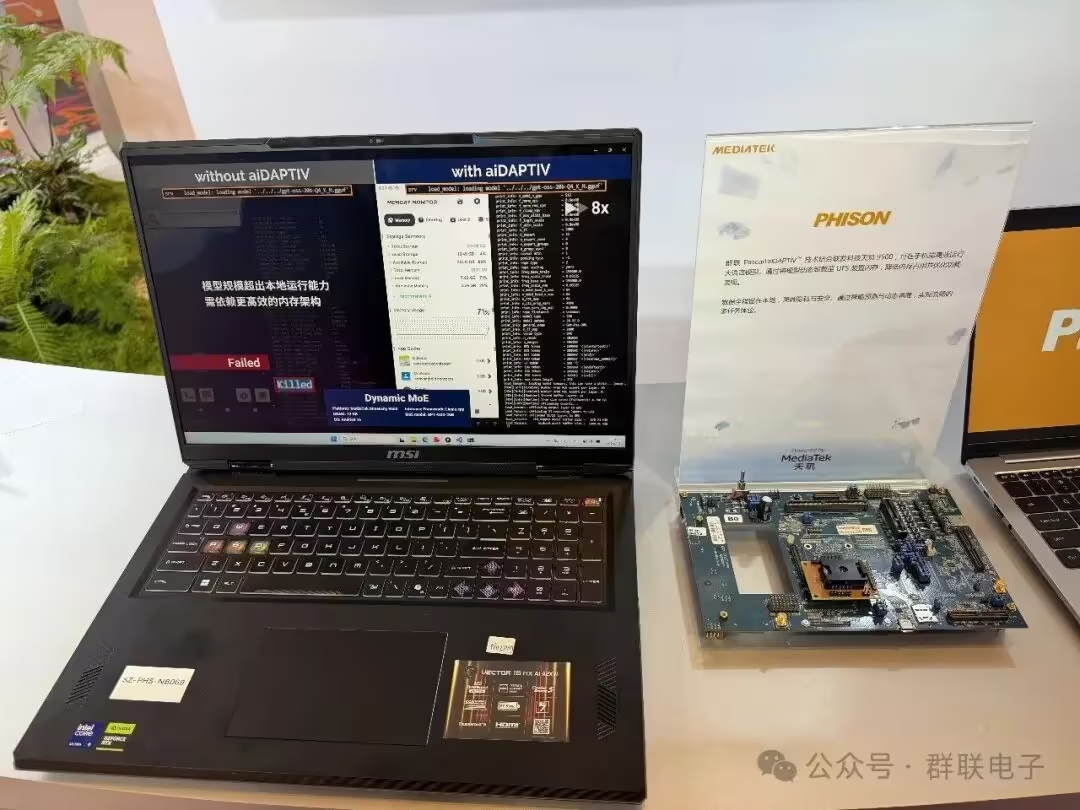

À la conférence développeurs Dimensity (MDDC 2026), Phison et MediaTek ont effectué une démonstration marquante : un grand modèle de langage de 20 milliards de paramètres tournant en local sur un smartphone équipé du SoC Dimensity 9500, sans connexion cloud. Le cœur de la prouesse tient au duo matériel‑logiciel « aiDAPTIV » de Phison, présenté comme la première solution UFS hybride brevetée permettant de déplacer dynamiquement une partie des poids d’un modèle MoE vers le stockage UFS, tout en maintenant l’exécution fluide avec 12 Go de mémoire vive.

aiDAPTIV Hybrid UFS : déporter les poids, soulager la RAM

Phison combine trois briques : aiDAPTIV Hybrid UFS côté stockage, aiDAPTIV Cache Memory pour gérer un cache actif des poids, et aiDAPTIV Middleware pour l’ordonnancement fin entre DRAM et UFS. L’ensemble vise à compenser la contrainte mémoire des modèles denses et surtout des architectures Mixture of Experts, en acceptant une hiérarchie de mémoire où la RAM n’est plus l’unique goulot.

Selon la démonstration, un modèle qui exigerait classiquement 16 Go ou plus de mémoire peut rester exploitable avec 12 Go, la différence étant déportée vers l’UFS tout en limitant l’impact en latence par une politique de cache dédiée. L’intérêt est clair pour les terminaux mobiles, où l’augmentation de la RAM a un coût énergétique et thermique non négligeable.

Pile MediaTek et écosystème Dimensity

MediaTek pousse en parallèle sa pile logicielle avec le moteur « Dimensity AI » en version 2.0 et le kit de développement « Dimensity AI » 3.0, destinés à industrialiser l’exécution locale d’agents et de modèles sur une large gamme d’équipements, du smartphone à l’automobile. Le Dimensity 9500 sert ici de plate‑forme de référence pour l’inférence on‑device de modèles à grande échelle.

Au‑delà de la vitrine technologique, l’enjeu est de rendre viable le déploiement d’IA générative en local sans escalade matérielle systématique. Réduire la dépendance à la DRAM, tout en contrôlant la latence induite par l’UFS, pourrait devenir un levier compétitif majeur pour les OEM sous Android haut de gamme en 2026.

Si la solution tient ses promesses en conditions réelles (variabilité des séquences, contextes longs, thermique soutenu), elle pourrait réorienter les priorités d’intégration côté terminaux : optimisation de la hiérarchie mémoire, tuning du firmware UFS et orchestration logicielle passeront avant la simple surenchère en capacité RAM, avec à la clé des coûts mieux contenus et une adoption plus large d’inférences 20B en local.

Source : ITHome