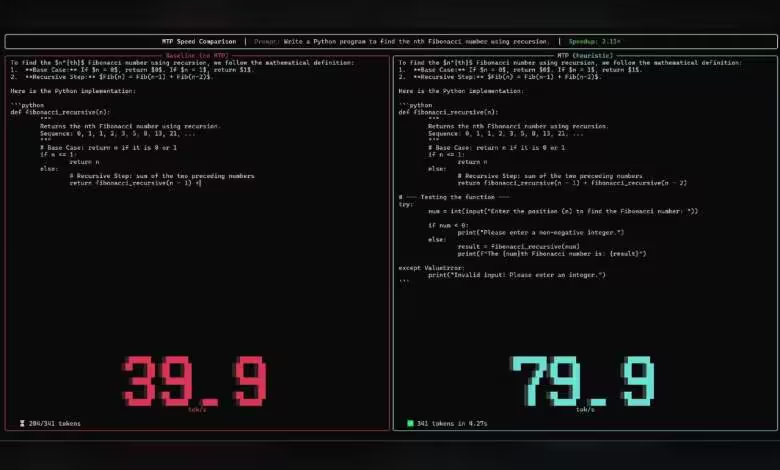

Google lance un « drafter » MTP pour la famille Gemma 4, un module de prédiction multi‑tokens adossé à un schéma de décodage spéculatif qui accélère l’inférence jusqu’à x3 sans dégrader la qualité de sortie. Présentée le 5 mai, l’implémentation cible le goulet d’étranglement le plus courant des LLM actuels : la latence liée à la bande passante mémoire et au va‑et‑vient des milliards de paramètres entre mémoire et unités de calcul.

Gemma 4, considéré comme l’open source le plus capable du catalogue Google, a dépassé les 60 millions de téléchargements en quelques semaines. Le drafter MTP vient s’y adjoindre sous la forme d’un modèle léger chargé d’anticiper plusieurs tokens d’avance quand le processeur et la carte graphique ne sont pas saturés, pendant que le modèle « cible » plus lourd (jusqu’à Gemma 4 31B) valide ces propositions en parallèle.

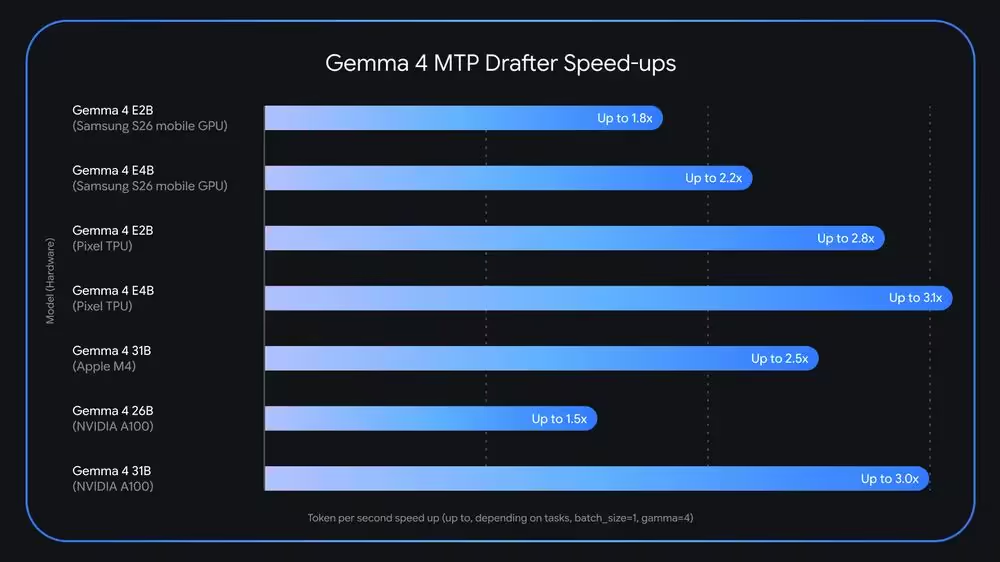

Si la séquence prédite passe la vérification, une seule passe de calcul suffit pour entériner un lot entier de tokens, ce qui abaisse mécaniquement le temps de génération. Google met en avant des gains concrets : sur Apple Silicon, avec des batch sizes de 4 à 8, Gemma 4 26B affiche environ x2,2 en local. Au‑delà des Mac, l’approche vise aussi les PC de bureau et les cartes graphiques grand public, avec à la clé une baisse sensible de la consommation sur les dispositifs en périphérie.

Décodage spéculatif, gains réels

Le verrou identifié par Google tient à l’utilisation imparfaite des unités de calcul, bridée par la mémoire. En intercalant un drafter MTP peu coûteux, le pipeline reste alimenté, les vérifications du modèle principal se parallélisent, et la latence chute, notamment dans les scénarios interactifs. Les cibles évidentes : chatbots, assistants de programmation, agents autonomes et applications mobiles où la réactivité prime.

Pour les développeurs, l’intérêt est double : exécuter des workflows complexes (coding offline, agents locaux) sur des machines personnelles sans sacrifier la précision, et déployer des LLM avancés dans des environnements contraints en mémoire ou en bande passante. L’architecture reste compatible avec des lots modestes, tout en tirant mieux parti des fenêtres de calcul oisives.

La stratégie est claire : généraliser le décodage spéculatif pour contenir le coût d’inférence à mesure que les modèles s’étoffent. Si les chiffres Apple Silicon sont prometteurs, l’enjeu sera la reproductibilité des gains sur un spectre plus large de cartes graphiques et de pilotes, ainsi que l’intégration propre dans les stacks inference courantes. À performance équivalente, la promesse d’un x2 à x3 sur la latence change la donne pour les usages temps réel et renforce l’attrait de Gemma 4 face aux offres concurrentes.

Source : ITHome