Une Tesla V100 en format SXM2 a fini dans un PC de bureau grâce à une simple carte adaptatrice PCIe. Le résultat est plus intéressant que l’idée ne le laisse penser : autour de 200 $ de matériel, soit environ 185 € hors taxes et autour de 220 € à 240 € une fois l’ensemble complété, l’ancienne puce serveur se montre très compétitive en inférence locale.

Tesla V100 : un montage SXM2 vers PCIe qui fonctionne vraiment

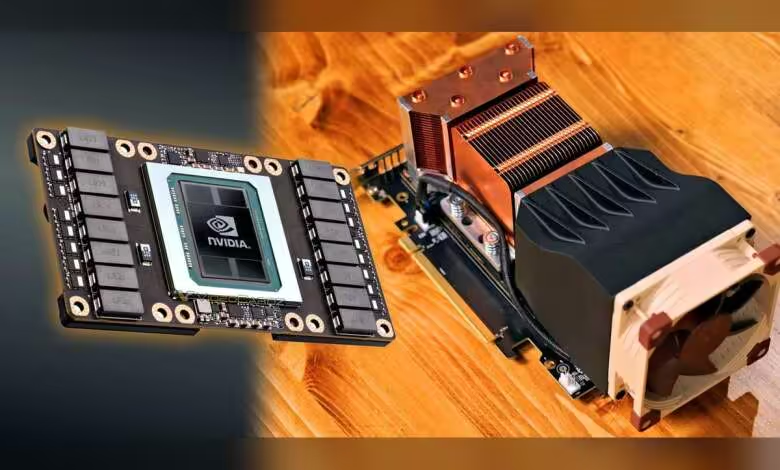

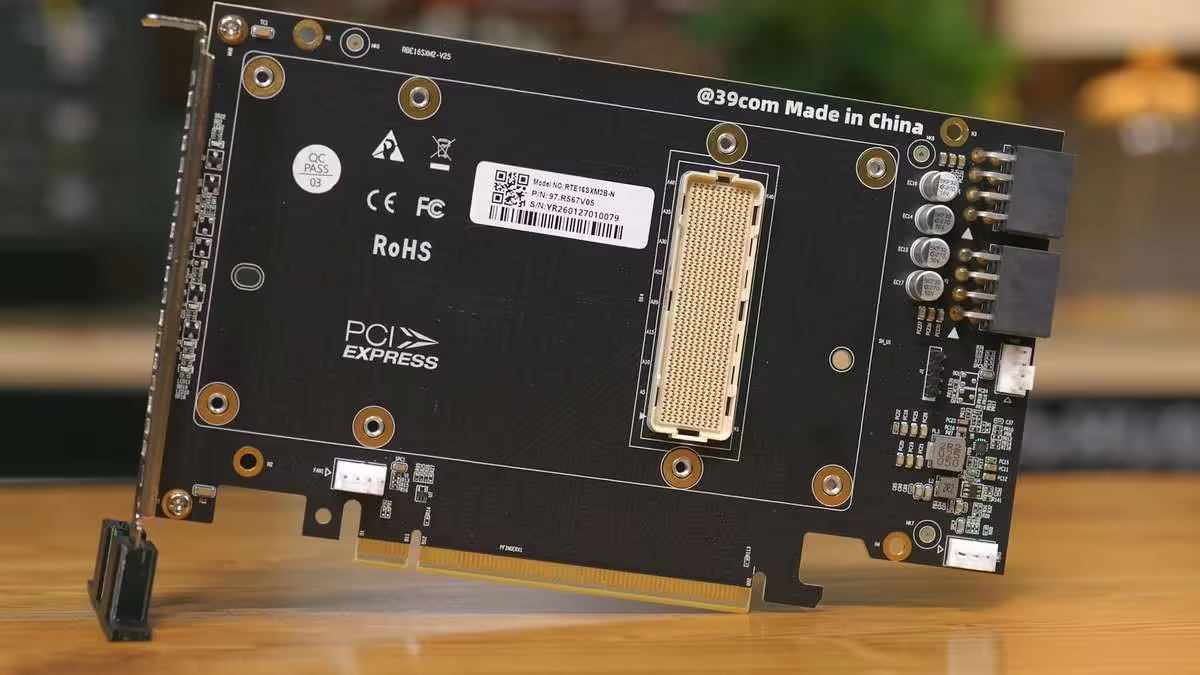

Hardware Haven a récupéré une V100 en format SXM2, puis l’a installée sur un adaptateur SXM2 vers PCIe. Ce point mérite d’être souligné : la version SXM2 n’est pas une carte PCIe classique, mais un module prévu pour un socket serveur, destiné aux charges IA, HPC et calcul, sans sortie vidéo.

NVIDIA avait commercialisé la V100 en versions PCIe et SXM2, avec 16 Go ou 32 Go de HBM2 selon les déclinaisons. Ici, il s’agit d’un modèle 16 Go. Pour un usage desktop, il faut aussi prévoir un affichage via l’iGPU ou une autre carte graphique.

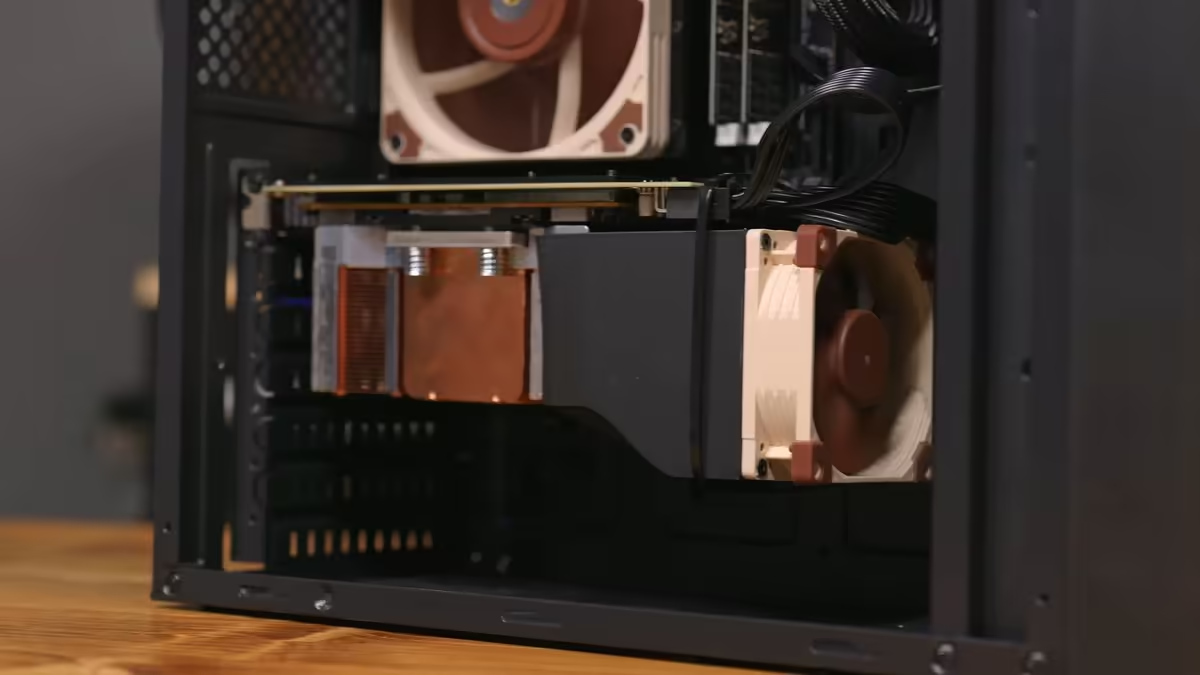

Refroidissement et coût réel

Le montage testé revient à environ 200 $ pour la V100 16 Go et l’adaptateur SXM2 vers PCIe. Hardware Haven a ajouté un ventilateur Noctua de 80 mm ainsi qu’un conduit imprimé en 3D, la carte reposant normalement sur le flux d’air d’un serveur.

Avec les taxes et les éléments de refroidissement, la configuration complète atteint environ 235 $, soit près de 215 € à titre indicatif. On reste loin d’une solution prête à l’emploi. Il faut accepter une intégration artisanale et un support logiciel moins confortable que sur une GeForce grand public.

Des résultats solides sous Ollama face aux GPU grand public

Sur gpt-oss-20b avec Ollama, la V100 délivre environ 130 tokens/s. Dans le même test, un système équipé d’une Radeon RX 7800 XT 16GB atteint environ 90 tokens/s.

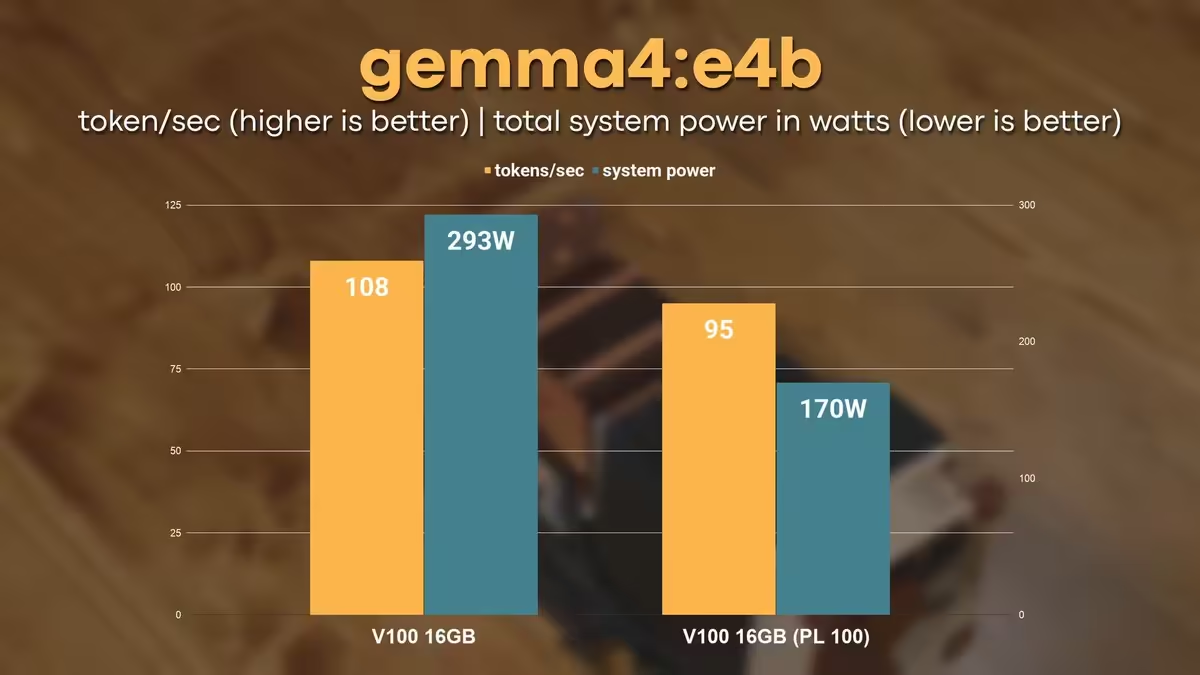

Sur Gemma 4 E4B, la V100 monte à 108 tokens/s, contre 76 tokens/s pour une RTX 3060 12GB. À réglages d’origine, le système V100 consomme davantage, mais garde malgré tout un léger avantage en tokens par watt face à la RTX 3060.

Le point le plus intéressant arrive avec une limite de puissance fixée à 100 W côté GPU. La V100 produit alors 95 tokens/s pour une consommation à la prise de 170 W, quand le système RTX 3060, lui aussi limité à 100 W, tombe à 68 tokens/s pour 171 W au mur.

Le repos reste moins flatteur : environ 45 W pour la machine équipée de la V100, contre 35 W avec la RTX 3060. Cette solution n’a donc rien d’universel, surtout sur une machine qui reste allumée longtemps hors charge.

Ce type de montage rappelle surtout qu’une carte datacenter déclassée peut conserver un vrai intérêt en inférence locale, à condition de viser un prix d’achat bas et d’accepter les contraintes de format, de refroidissement actif et d’absence d’affichage. Pour un usage jeux vidéo, l’intérêt est nul. Pour un petit poste dédié à Ollama, le rapport performances/prix peut en revanche devenir très compétitif.

Source : VideoCardz