La bataille de l’IA se joue de plus en plus sur les interconnexions, pas seulement sur la puissance brute. Rambus ajoute une nouvelle brique à ce jeu d’équilibriste avec un switch pensé pour exploiter plus finement les liens PCIe dans les architectures massivement parallèles.

Un switch PCIe 7.0 taillé pour les SoC IA et cloud

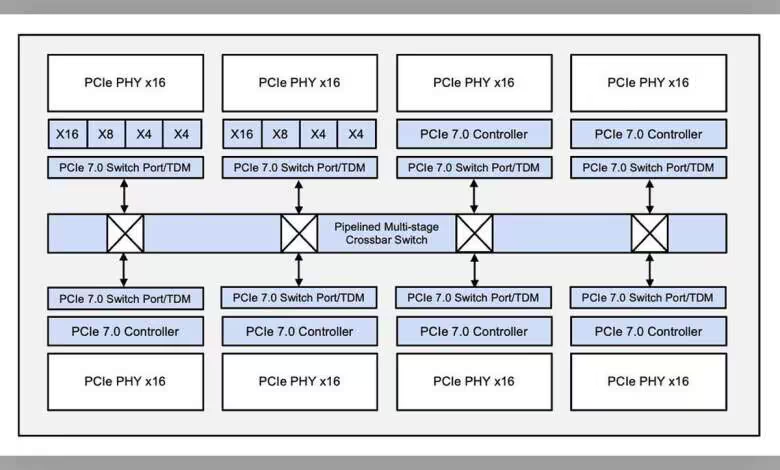

Rambus a présenté un PCIe 7.0 Switch IP with Time Division Multiplexing, une nouvelle propriété intellectuelle qui vient étoffer son portefeuille d’interconnexions avancées. Le bloc vise directement les systèmes IA, cloud et HPC confrontés à une hausse rapide des besoins en bande passante, en latence maîtrisée et en montée en charge.

Dans les infrastructures IA actuelles, le problème n’est plus seulement de relier plus de CPU, de GPU, d’accélérateurs et de SSD NVMe. Il faut aussi déplacer d’énormes volumes de données de manière plus efficace entre ressources hétérogènes, y compris dans des architectures désagrégées ou mutualisées.

Le TDM comme levier d’utilisation et de latence

Le point distinctif de cette IP est l’intégration du Time Division Multiplexing. Rambus explique que cette approche permet de planifier et multiplexer intelligemment le trafic sur des liens partagés, afin d’améliorer l’utilisation globale du fabric tout en conservant une latence faible et un comportement déterministe.

Le switch est annoncé comme optimisé pour les SoC IA et datacenter de prochaine génération qui demandent une densité de bande passante très élevée, une gestion avancée du trafic et une scalabilité plus propre. Rambus met aussi en avant la capacité à couvrir des profils de charge très différents, du training IA à grande échelle jusqu’à l’inférence sensible à la latence et aux transferts de données massifs.

Rambus vise le scale-up comme le scale-out

Simon Blake-Wilson, senior vice president et general manager of Silicon IP chez Rambus, estime qu’il ne suffit plus d’ajouter davantage de lignes PCIe ou d’endpoints. Selon lui, ce switch PCIe 7.0 avec TDM doit offrir aux architectes systèmes plus de liberté pour faire évoluer la bande passante de manière efficace et déterministe, tout en réduisant la complexité et en améliorant l’utilisation globale du système.

Jeff Janukowicz, VP Semiconductors and Enabling Technologies, va dans le même sens : l’efficacité des mouvements de données entre calcul et mémoire devient un facteur central dans les plateformes IA. Les technologies de commutation capables d’améliorer l’utilisation des liens et d’orchestrer plus souplement le trafic devraient donc peser lourd dans la conception des prochaines infrastructures interconnectées.

Une pièce de plus dans le portefeuille PCIe 7.0 de Rambus

Rambus précise que cette IP est conçue pour s’intégrer dans des plateformes ASIC de pointe. Elle vient compléter un ensemble plus large d’IP PCIe 7.0 comprenant déjà des contrôleurs, des retimers et des solutions de debug, avec l’objectif classique d’accélérer le time-to-market tout en répondant aux contraintes de performances, de consommation et de fiabilité des infrastructures IA modernes.

Au-delà de l’annonce produit, le message est clair : à mesure que les clusters IA se complexifient, la valeur se déplace vers des interconnexions capables de mieux arbitrer les flux plutôt que de simplement multiplier les ressources physiques. Si le TDM tient ses promesses en implémentation réelle, ce type de switch pourrait devenir une brique importante dans les designs où le coût, la densité et la prévisibilité comptent autant que le débit brut.

Source : TechPowerUp