Google présente A2UI 0.9, un standard de « generative UI » pensé pour permettre à des agents d’IA de composer des interfaces à la volée en s’appuyant sur des composants applicatifs existants. L’initiative, signalée par The Decoder, formalise un socle commun et des outils prêts à l’emploi pour intégrer, rendre et synchroniser des éléments d’UI générés par des modèles.

Ce que propose A2UI 0.9

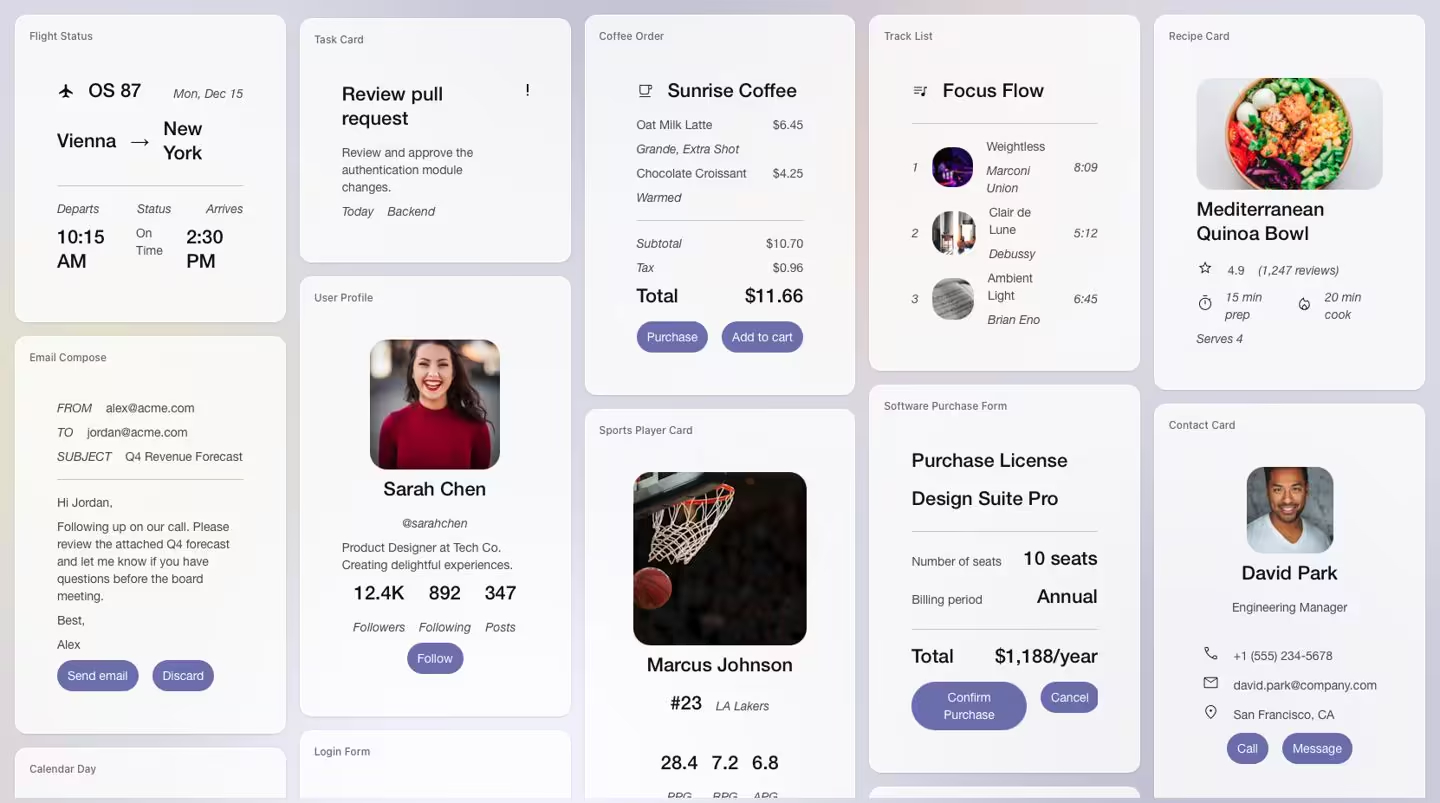

Le kit apporte un core Web mutualisé, un renderer officiel pour React, et des mises à jour de moteurs de rendu côté Flutter, Lit et Angular. Un Agent SDK fait son apparition, installable via Python, pour normaliser la description, l’assemblage et l’exécution d’interfaces construites par des agents.

Google annonce aussi l’arrivée de déclinaisons Go et Kotlin, ainsi que l’introduction de fonctions personnalisées côté client, d’une synchronisation client–serveur et d’améliorations sur la gestion des erreurs. L’écosystème A2UI s’aligne déjà avec AG2, A2A 1.0 et json-render, ce qui ouvre la porte à des intégrations rapides dans des stacks existantes sans refonte complète du front.

Enjeux pour les développeurs

L’intérêt d’un standard A2UI est double : réduire la friction entre la génération d’intentions par un agent et leur projection en composants UI concrets, tout en gardant la main sur le rendu via des frameworks matures. Le support multi‑frameworks et un SDK unifié limitent l’effet de silo et rendent plus crédible l’industrialisation d’UI génératives au‑delà des démos.

Si la promesse tient en production, A2UI pourrait réorienter la chaîne front autour de composants « invocables » par les agents plutôt que de pages monolithiques. Les équipes gagneraient en vélocité sur des parcours dynamiques, avec un coût d’intégration maîtrisé grâce aux renderers officiels et à la synchronisation de données intégrée.

Source : ITHome