La course à l’IA avale toute la mémoire disponible, au point de faire émerger un risque paradoxal : si l’industrie ne livre pas plus de DRAM, ses plus gros clients finiront par apprendre à s’en passer en partie. C’est la tension décrite par Chey Tae-won, président de SK Group et superviseur de SK hynix.

Une demande DRAM tirée au maximum par les datacenters IA

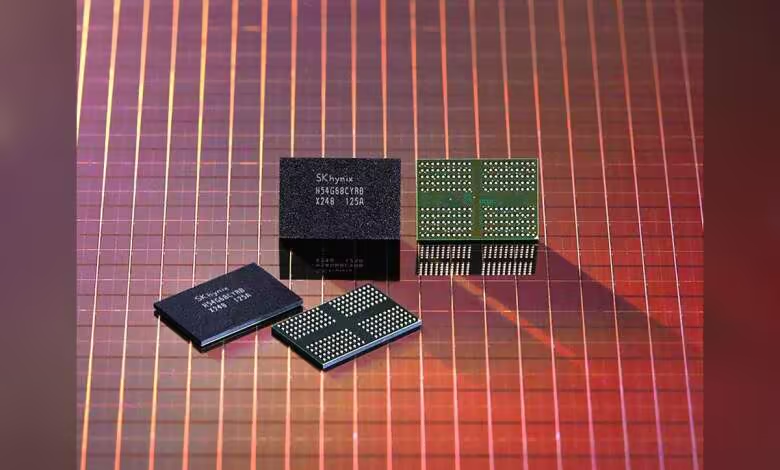

Les fabricants comme Samsung, SK hynix et Micron cherchent actuellement un point d’équilibre délicat entre l’approvisionnement du marché et l’expansion de leurs capacités via de nouvelles commandes pour les fabs de semi-conducteurs dédiées à la mémoire. En face, les hyperscalers et les concepteurs d’accélérateurs IA comme AMD, NVIDIA et d’autres sécurisent autant de mémoire que possible.

La logique est simple : l’expansion des datacenters IA exige toujours plus de DRAM côté GPU et CPU, aussi bien pour l’entraînement que pour l’inférence de très grands modèles. On parle désormais de modèles atteignant des dizaines de milliers de milliards de paramètres, avec des besoins de plusieurs centaines de gigaoctets de mémoire système pour héberger un seul modèle destiné à seulement quelques utilisateurs.

SK hynix prépare la suite, mais les nouvelles capacités resteront lointaines

Le problème, c’est que toute la chaîne est déjà sous pression. Les fabricants de mémoire écoulent leur DRAM disponible avec plusieurs mois d’avance, tout en restant prudents sur les investissements massifs, alors même qu’ils ont vu la hausse de la demande venir depuis des années.

Cette retenue alimente la pénurie actuelle, mais elle s’explique aussi par les délais industriels. Construire de nouvelles fabs mémoire prend plusieurs années, au moment même où la demande projetée pourrait commencer à se stabiliser. SK hynix a tout de même commandé environ 20 machines EUV Low-NA à ASML pour ses plans d’expansion, avec en perspective un soutien futur à la production de stockage une fois ces outils opérationnels.

Moins de mémoire consommée, ou simplement mieux utilisée

Chey Tae-won souligne que les clients commencent déjà à réduire la pression mémoire via des optimisations sur l’entraînement et l’inférence. L’usage de formats de données à plus faible précision et de meilleures optimisations logicielles peut alléger nettement la charge mémoire dans les infrastructures.

Reste une limite bien connue de l’industrie : quand le matériel devient plus efficace, le logiciel finit généralement par absorber le gain pour augmenter la charge totale. En clair, si l’on sert les tokens plus efficacement, la consommation de tokens grimpe à son tour. Toute la question est désormais de savoir comment cet équilibre entre optimisation, tension sur la chaîne d’approvisionnement et futurs investissements dans les fabs DRAM va évoluer.

Pour le marché, le signal est important : si l’offre ne s’élargit pas assez vite, la prochaine phase de croissance de l’IA pourrait moins dépendre d’une abondance de mémoire que d’un meilleur rendement par watt, par token et par gigaoctet. Cela ne réduira pas la valeur stratégique de la DRAM, mais pourrait freiner l’emballement des volumes attendus à moyen terme.

Source : TechPowerUp