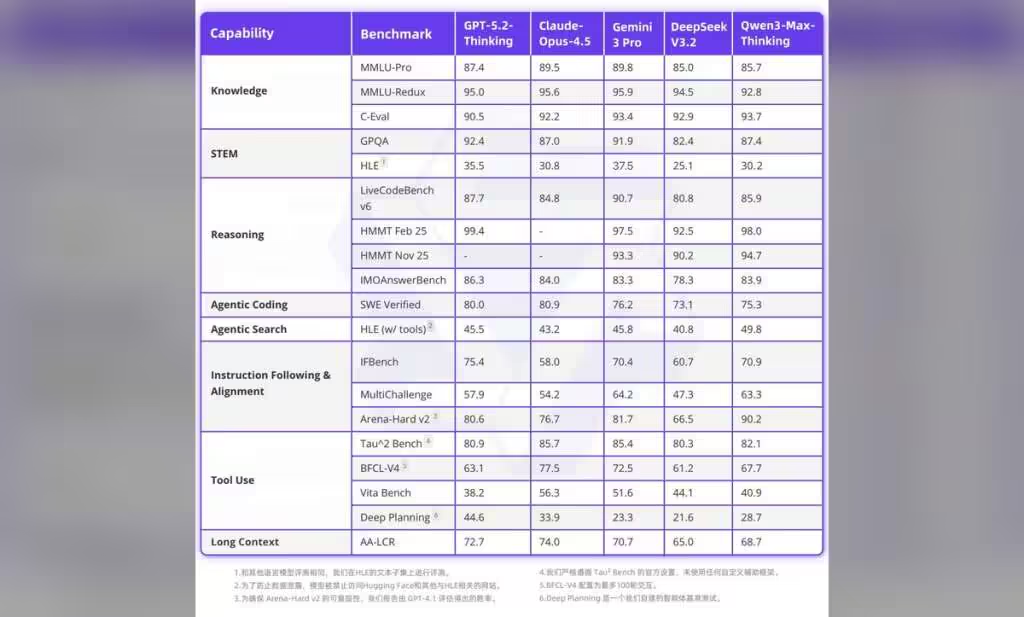

Alibaba a dévoilé ce soir Qwen3-Max-Thinking, nouveau modèle « reasoning » haut de gamme de la famille Qwen. La société annonce une architecture dépassant le millier de milliards de paramètres, un entraînement par renforcement élargi et des avancées nettes sur la factualité, le raisonnement complexe, l’alignement et l’utilisation native d’outils. Sur 19 benchmarks de référence, Alibaba revendique des performances du niveau de GPT-5.2-Thinking, Claude Opus 4.5 et Gemini 3 Pro.

Le modèle est disponible dans Qwen Chat avec une capacité de recours autonome au moteur de recherche, à la mémoire et à un interpréteur de code. L’API publique est ouverte sous l’identifiant « qwen3-max-2026-01-23 ».

Focus technique et perfs mesurées

Qwen3-Max-Thinking met l’accent sur deux briques. D’abord, une invocation d’outils auto-adaptative : le modèle choisit et orchestre seul la recherche, la mémoire et l’exécution de code, après un cycle de fine-tuning spécifique puis un entraînement supplémentaire guidé par retours hybrides (règles et feedback modèle). Alibaba indique une baisse sensible des hallucinations, un accès temps réel aux informations et des réponses mieux personnalisées.

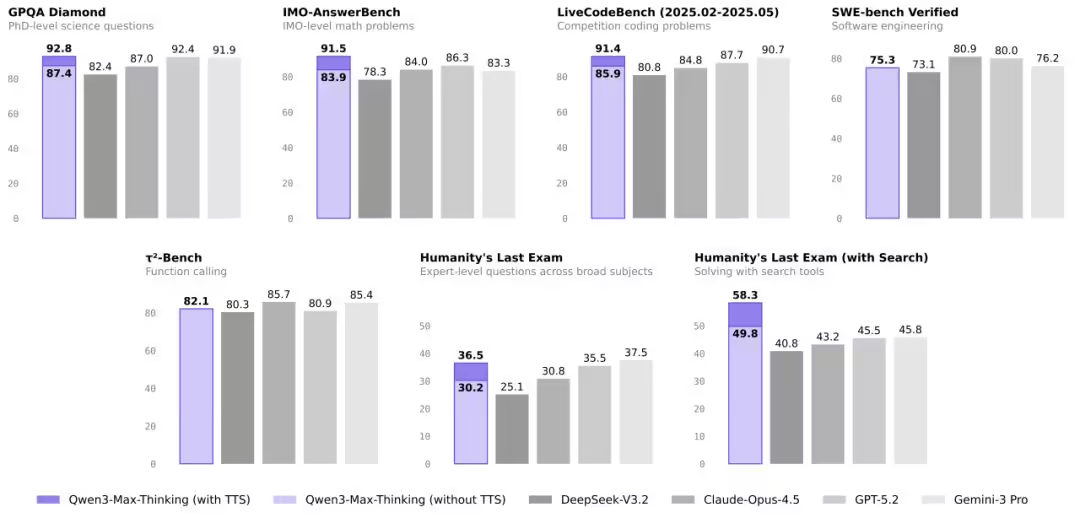

Ensuite, une stratégie de Test-Time Scaling itératif orientée « expérience cumulée ». Plutôt que d’augmenter simplement le nombre de trajectoires en parallèle, Qwen3-Max-Thinking limite ces chemins et réinvestit le budget de calcul dans des boucles de réflexion successives. Un mécanisme d’extraction d’« insights » issus des tours précédents évite les répétitions et concentre le raisonnement sur les zones d’incertitude, avec une meilleure utilisation de la fenêtre de contexte à consommation de tokens comparable.

Les gains annoncés, à méthodologie constante, sont chiffrés sur plusieurs suites: GPQA de 90,3 à 92,8, HLE de 34,1 à 36,5, LiveCodeBench v6 de 88,0 à 91,4, IMO-AnswerBench de 89,5 à 91,5, et HLE avec outils de 55,8 à 58,3. Alibaba met en avant des résultats en tête sur GPQA Diamond (sciences), IMO-AnswerBench (maths) et LiveCodeBench (code).

Disponibilité et intégration

Qwen3-Max-Thinking est accessible via Qwen Chat (chat.qwen.ai), avec la sélection automatique d’outils activée, et via l’écosystème Alibaba Cloud Bailian. Le déploiement vise autant l’usage direct que l’intégration agentique, le modèle étant conçu pour raisonner tout en exécutant des appels outils de manière fluide.

Au-delà de la surenchère paramétrique, l’enjeu se déplace vers la chaîne de raisonnement et l’efficacité du calcul à l’inférence. La mise en avant d’un Test-Time Scaling mieux capitalisé et de capacités agent natives confirme la bascule des LLM généralistes vers des systèmes orientés tâches, où le pilotage d’outils et la discipline du raisonnement comptent autant que le score brut sur benchmarks.

Source : ITHome