Sam Altman a annoncé sur X le lancement d’un « mois Codex » chez OpenAI, avec une première salve de produits attendue la semaine prochaine. Codex ne se limite plus à un simple API de complétion : l’éditeur le positionne comme un véritable environnement d’ingénierie logicielle, combinant modèles, outils et enchaînements de tâches sous la forme d’un agent logiciel opérationnel.

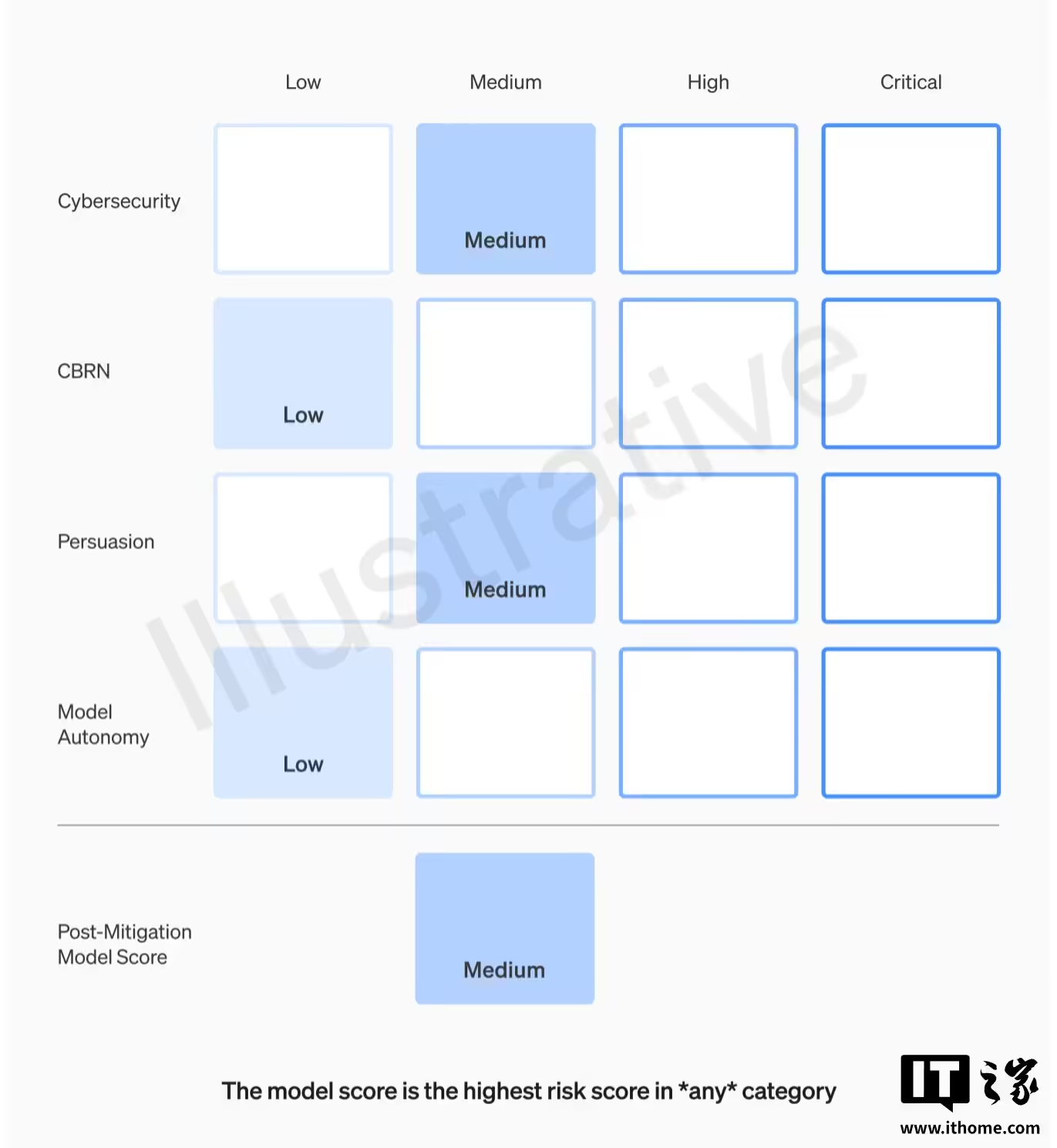

OpenAI prévient que les nouveaux modèles Codex atteignent pour la première fois le niveau « High » de risque cybersécurité dans son Preparedness Framework, juste en dessous du palier « Critical ». En clair, les capacités franchissent le seuil où l’IA peut lever des verrous techniques existants côté attaque, de l’assistance à la création d’outils d’offensive à l’automatisation d’opérations de bout en bout, jusqu’à la découverte et l’exploitation autonome de vulnérabilités jugées exploitables.

Le risque systémique est explicite : un déséquilibre du rapport attaque/défense, avec une hausse du volume et de l’ampleur des intrusions. OpenAI dit adopter un déploiement par étapes : d’abord des restrictions strictes d’usage pour réduire l’abus criminel, puis un recentrage sur « l’accélération de la défense », en s’appuyant sur l’IA pour identifier et corriger plus vite les failles côté utilisateurs et équipes produit.

Feuille de route et garde-fous annoncés

Altman assume une philosophie de publication contrôlée : ne pas sortir les modèles ne serait « pas une solution » alors que des versions plus puissantes émergeront inévitablement. L’objectif affiché est d’augmenter dès maintenant le niveau de sécurité logiciel chez les développeurs et entreprises, tout en calibrant les capacités exposées pour limiter l’industrialisation d’attaques.

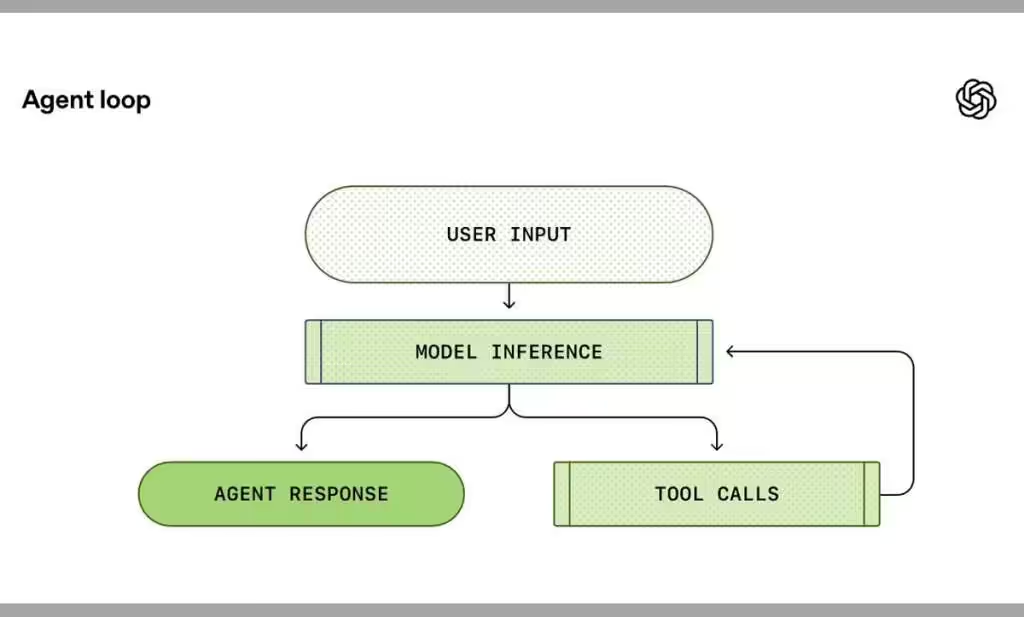

En parallèle de l’annonce sur X, OpenAI a détaillé sur son site la logique interne de Codex CLI, un agent local multiplateforme. Le cœur est un « Agent Loop » chargé d’orchestrer les interactions entre l’utilisateur, le modèle et les outils : transformation des instructions en tokens, raisonnement, appels d’outils (y compris opérations fichiers), puis synthèse d’une réponse exécutable.

Codex CLI et boucle d’agent

Cette boucle vise à fiabiliser des séquences d’actions répétables et auditable, un point clé pour contenir les dérives tout en conservant la vitesse d’itération promise par l’IA. L’approche outille surtout l’exécution locale, ce qui peut faciliter l’intégration dans des pipelines CI/CD et des environnements de développement verrouillés.

Si OpenAI parvient à livrer un gain net côté défense avant que les capacités d’attaque ne se diffusent, l’impact pourrait être tangible sur les cadences de remédiation, la priorisation des correctifs et la qualité des bases de code. Le point d’équilibre dépendra toutefois des seuils de restriction retenus, de la transparence des journaux d’actions de l’agent et de l’adoption réelle dans les chaînes outillées des grands éditeurs.

Source : ITHome