NVIDIA étend son terrain de jeu au-delà du GPU: Jensen Huang confirme que le CPU haute performance Vera sera vendu en produit autonome, avec un objectif clair : entrer dans l’arène Xeon/EPYC.

NVIDIA Vera CPU entre en lice face aux Xeon et EPYC

Jensen Huang annonce la mise sur le marché des CPUs Vera séparément du reste de l’infrastructure NVIDIA. Il promet des premiers déploiements rapides, citant CoreWeave comme candidat pressé, tout en précisant qu’aucun design win n’est encore officialisé.

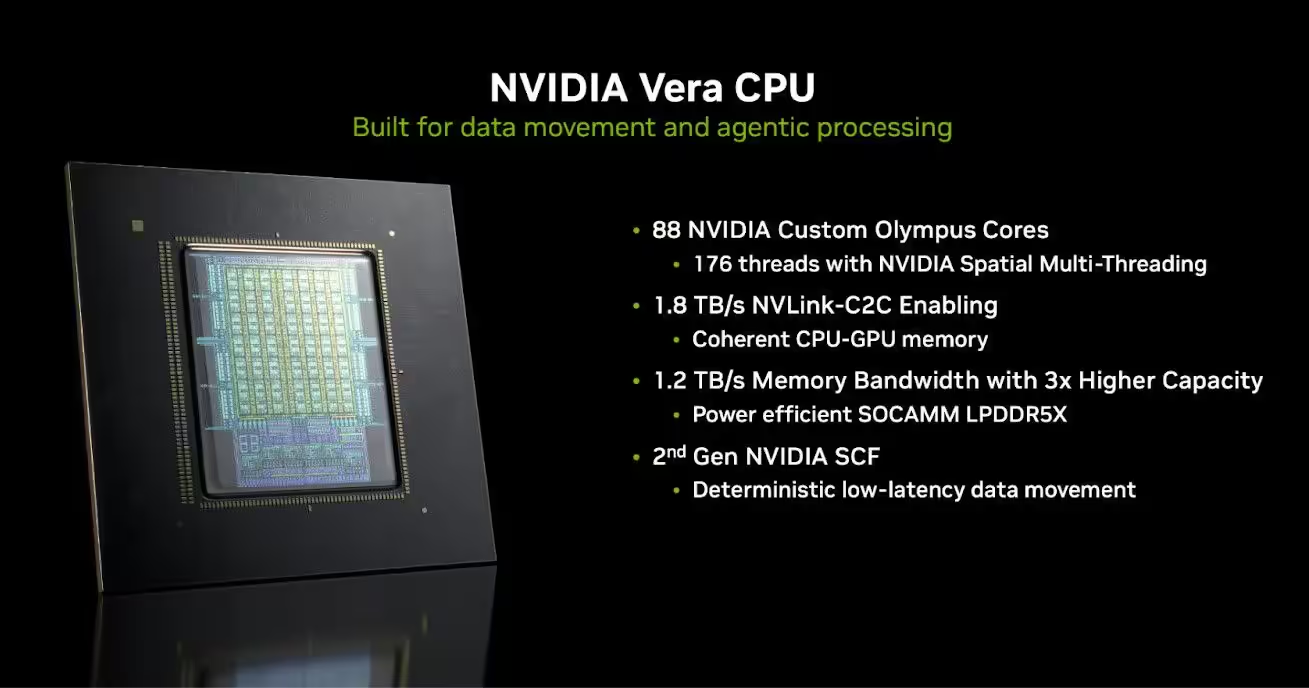

Vera aligne 88 cœurs Armv9.2 « Olympus » personnalisés avec Spatial Multithreading pour 176 threads via partitionnement des ressources. Particularité notable, ces cœurs supportent nativement le FP8 et embarquent une implémentation SVE2 6×128-bit, de quoi déporter certaines charges IA sur le CPU.

Le contrôleur mémoire atteint 1,2 TB/s et gère jusqu’à 1,5 TB de LPDDR5X. Reste une incertitude : en version autonome, le support d’options externes type DDR5 RDIMM n’est pas clarifié, ce qui poserait la question d’un design centré sur de la LPDDR5X soudée au PCB.

Architecture, interconnexions et bande passante

Le fabric de cohérence scalable de seconde génération offre 3,4 TB/s de bisection bandwidth et relie l’ensemble des cœurs sur un die monolithique, contournant les latences habituelles des architectures chiplet. Côté accélérateurs, le NVLink Chip-to-Chip de seconde génération aligne jusqu’à 1,8 TB/s de bande passante cohérente vers les GPUs « Rubin ».

Sur le papier, ce couplage CPU Armv9.2/FP8 et NVLink C2C place Vera comme pivot potentiel pour des nœuds IA plus homogènes, mêlant calcul généraliste, mémoire à très haut débit et proximité GPU sans goulots d’étranglement PCIe classiques.

Positionnement marché et premières cibles

NVIDIA vise explicitement les workloads serveurs face à Intel Xeon et AMD EPYC. Le discours de Huang suggère un time-to-deploy agressif pour les clouds spécialisés IA; CoreWeave est cité, sans exclusivité ni calendrier. L’absence d’annonce de design wins laisse le champ ouvert aux intégrateurs prêts à miser sur la cohérence CPU/GPU maison.

Si Vera délivre en production ce qu’il promet sur le plan FP8 et bande passante mémoire, NVIDIA pourrait récupérer des portions de charges IA aujourd’hui cantonnées aux GPUs, tout en gardant l’avantage d’un lien NVLink cohérent vers Rubin. La question mémoire (LPDDR5X seule ou mix avec RDIMM) sera déterminante pour l’adoption en data centers généralistes.

Source : TechPowerUp