Des équipes éclatées, des assets toujours plus lourds, des cycles QA sous tension. NVIDIA pousse la centralisation GPU pour garder la réactivité d’une station haut de gamme tout en rationalisant l’infra.

NVIDIA RTX PRO Server pour studios : virtualisation de bout en bout

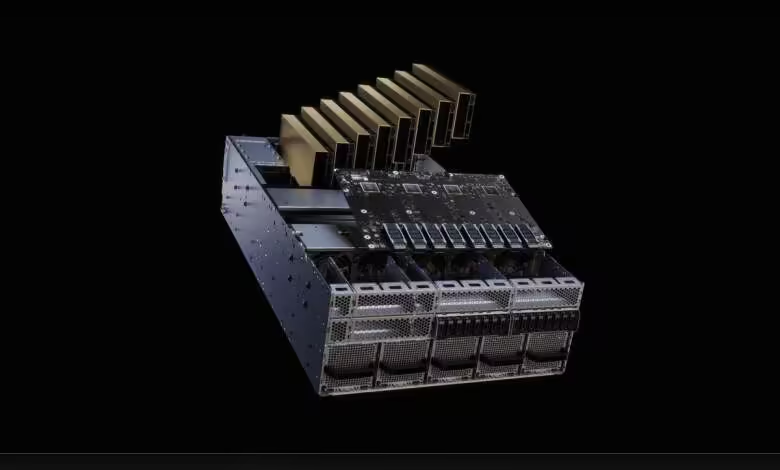

Présenté à la GDC de San Francisco, le NVIDIA RTX PRO Server s’appuie sur des GPU RTX PRO 6000 Blackwell Server Edition et le logiciel NVIDIA vGPU pour centraliser créa 3D, ingénierie, IA et QA sur une même infrastructure GPU en datacenter. Objectif : regrouper les ressources, allouer la performance par workload et maintenir des environnements cohérents entre sites et prestataires.

La bascule d’un parc de stations dispersées vers un pool GPU partagé permet d’exécuter entraînement IA, simulation et automatisation de jeu la nuit, puis de réallouer dynamiquement ces ressources au développement interactif le jour. À la clé : meilleure utilisation, moins d’idle et des pipelines QA extensibles sans multiplier le hardware local.

MIG + vGPU : profils isolés, jusqu’à 48 utilisateurs par GPU

Le GPU RTX PRO 6000 Blackwell Server Edition embarque 96 Go de mémoire, de quoi juxtaposer applications lourdes et inférence de modèles plus grands aux côtés de workflows temps réel. La technologie NVIDIA Multi-Instance GPU (MIG) partitionne un GPU en instances isolées (mémoire, compute, cache dédiés). Combinée à vGPU, elle permet une allocation sécurisée par utilisateur ou charge.

En configuration mixte MIG + vGPU, un seul RTX PRO 6000 Blackwell Server Edition peut supporter jusqu’à 48 utilisateurs concurrents, tout en préservant l’isolation de performance. Les artistes accèdent à des stations RTX virtuelles pour 3D traditionnelle et génération IA, les développeurs disposent d’environnements homogènes pour le code et la 3D, les chercheurs IA profitent de profils à grande mémoire pour fine-tuning, inférence et agents, et la QA valide gameplay et perfs sur la même architecture Blackwell que les GeForce RTX 50 Series.

Intégration entreprise et continuité IT

Les RTX PRO Servers se déploient via NVIDIA vGPU sur hyperviseurs et postes distants compatibles, sans architecture exotique. Des éditeurs majeurs exploitent déjà vGPU pour étendre une infra centrale et lisser l’efficacité à l’échelle studio, avec des pratiques d’exploitation datacenter standardisées.

La promesse est claire : une plateforme unique pour synchroniser graphisme temps réel et IA, réduire la dérive logicielle des postes et accroître la capacité QA à la demande. Si les coûts d’infrastructure et de réseau resteront le point de friction, la mutualisation GPU et l’élasticité jour/nuit constituent un levier immédiat pour des pipelines jeu plus denses.

Source : TechPowerUp